Paginering of gepagineerde content is het verdelen van content over meerdere pagina’s.

Paginering of gepagineerde content is het verdelen van content over meerdere pagina’s.

Hoe ga je daar mee om vanuit zoekmachine-optimalisatie (SEO) oogpunt?

Een handleiding met de belangrijkste SEO problemen en oplossingen van paginering.

Gepagineerde content?

Als je content verdeeld over meerdere pagina’s, noem je dat gepagineerde content.

Het pagineren van content – ook wel paginering of paginatie genoemd – is in feite niks anders dan het opdelen van content en nummeren van de verschillend pagina’s.

SEO problemen paginatie

Gepagineerde content levert altijd een aantal SEO problemen.

Alle pagina’s waarover de gepagineerde content verdeeld is, lijken namelijk meestal op elkaar.

Dat levert 4 SEO problemen op:

- Duplicate content:

alle gepagineerde pagina’s concurreren met elkaar in de zoekresultaten - Linkwaarde verspilling:

de linkwaarde wordt over alle gepagineerde pagina’s verdeeld - Crawl “budget” verspilling:

de maximale crawl capaciteit van je site wordt onnodig verbruikt aan identieke pagina’s - “Diepe” content onbereikbaar

Links op vervolgpagina’s achteraan een gepagineerde serie worden niet gecrawld (en de pagina’s daarachter zijn dus niet vindbaar)

Problemen & Oplossingen

Hieronder ga ik uitgebreid in op de SEO problemen en oplossingen voor gepagineerde content.

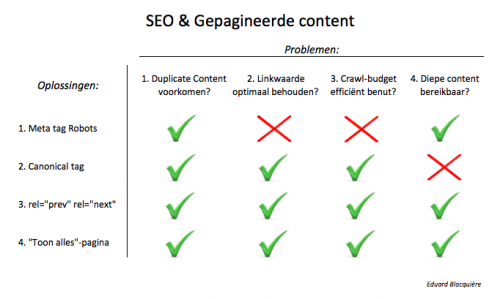

Hierbij alvast in schema de problemen en oplossingen:

1. Duplicate content

Duplicate content betekent dat dezelfde (of identieke) content bereikbaar is op meerdere URL’s.

Duplicate content betekent dat dezelfde (of identieke) content bereikbaar is op meerdere URL’s.

Zoekmachines zullen één URL kiezen en in de zoekresultaten tonen. De andere, dubbele URL’s worden uit de zoekmachine index verwijderd.

Geen groot probleem

Duplicate content is niet het ergste probleem bij paginatie.

Google en andere zoekmachines snappen dit steeds beter.

En het is makkelijk op te lossen.

(bijv. met een canonical tag, zie hieronder)

Minder crawlen

Een zorgwekkender gevolg van duplicate content is een crawl probleem: bij veel duplicate content besluit Google je site minder te gaan crawlen.

De redenatie van Google?

Alle identieke/dubbele content maken de site minder waard.

(lees meer over crawlen bij punt 3 “crawl & indexatie budget”)

2. Linkwaarde verspilling

De verspilling van linkwaarde heeft een belangrijk negatief effect op je SEO resultaten.

De verspilling van linkwaarde heeft een belangrijk negatief effect op je SEO resultaten.

Je wilt namelijk alle linkwaarde op – niet meer en niet minder dan – één unieke URL/pagina opbouwen.

Maar bij gepagineerde content verdeel je de linkwaarde over meerdere, identieke pagina’s.

En dan krijgt elke pagina een beetje linkwaarde, waarmee geen van alle pagina’s een sterke basis heeft voor goede posities in de zoekresultaten.

Zonde dus.

3. Crawl “budget” verspilling

Een derde, minder bekend probleem, is de verspilling van je crawl “budget”.

Een derde, minder bekend probleem, is de verspilling van je crawl “budget”.

Definitie crawler:

De crawler, ook wel ’spider’ of ‘(ro)bot’ genoemd, is een relatief eenvoudig computer programma dat niets anders doet dan links volgen en de HTML versie van de webpagina opslaan in een database, de index.

Bron: Handleiding: Hoe werkt een zoekmachine?

Elke website heeft een maximaal crawl budget: het maximum aantal keer per periode dat jouw website gecrawlt wordt door een zoekmachine.

(Datzelfde geldt overigens voor het aantal te indexeren pagina’s van een website)

Hoeveel pagina’s maximaal?

Je vraagt je wellicht af: is er een maximum aantal pagina’s te noemen per site?

Nee.

Dat aantal is namelijk relatief. Namelijk, gerelateerd aan de autoriteit van je site.

Factoren crawl & indexatie budget

Zoals alles bij Google (en andere zoekmachines) is niet precies bekend welke factoren meewegen.

Maar zeker is dat de autoriteit van jouw website doorslaggevend is.

Simpel gezegd: de combinatie van het aantal links en vermeldingen van je site en de kwaliteit ervan.

Google’s Matt Cutts bevestigde dit in maart 2010:

“… the number of pages that we crawl is roughly proportional to your PageRank”

(Bron: Stonetemple.com)

PageRank of linkwaarde

Google noemt de autoriteit van een site sinds jaar en dag natuurlijk PageRank. Al gaat autoriteit of linkwaarde verder dan alleen de Google PageRank waarde.

Definitie PageRank:

PageRank is een nummerieke waarde die Google aan alle bij Google bekende individuele webpagina’s toewijst, op basis van de naar een webpagina verwijzende links, om te bepalen hoe belangrijk deze webpagina’s zijn ten opzichte van elkaar.

(Zie voor meer uitleg mijn PageRank handleiding)

Hoe minder de PageRank of linkwaarde van een pagina, hoe minder deze gecrawld wordt.

En hoe minder kans je maakt om in de index en dus in de zoekresultaten te verschijnen.

4. “Diepe” content onbereikbaar

Een 4e SEO probleem van gepagineerde content is dat “diepe” content niet bereikbaar is voor zoekmachines.

Een 4e SEO probleem van gepagineerde content is dat “diepe” content niet bereikbaar is voor zoekmachines.

Stel, je hebt een webwinkel met een productgroep waar je heel veel artikelen van hebt, dan heeft die productgroep-pagina veel gepagineerde content.

Artikelen die dan bijvoorbeeld op de 10e of 20e gepagineerde pagina staan, worden in het ergste geval niet meer gecrawlt.

Het resultaat: die artikelen zijn niet vindbaar in zoekmachines.

4 SEO oplossingen Paginatie

Er zijn 4 SEO oplossingen voor gepagineerde content, te weten:

- Meta tag robots

- Canonical tag

- rel=”prev” & rel=”next”

- “Toon alles” pagina

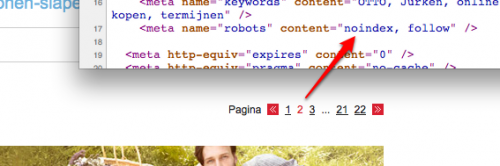

1: meta tag robots

Een veel gebruikte SEO oplossing voor paginatie is het gebruik van de meta tag robots met de waarde “noindex,follow” vanaf gepagineerde pagina 2 en verder.

De meta robots tag plaats je per pagina in de head-sectie van de HTML:

Hiermee wordt alleen de 1e pagina in de gepagineerde serie geïndexeerd en de rest niet (door de waarde “noindex”).

Linkwaarde behouden

Als er vanuit de site (interne links) of van buiten de site (externe links) naar een gepagineerde pagina wordt gelinkt, behoud je de linkwaarde (door de waarde “follow”).

Alle linkwaarde die terecht komt bij pagina 2 en verder, wordt daar gewoon per pagina opgebouwd en doorgegeven aan de links op die pagina’s.

Bijvoorbeeld, bij een webwinkel met veel producten in een categorie worden producten die op gepagineerde pagina’s staan dus ook gewoon gecrawld.

Ja, pagina’s die niet geïndexeerd zijn, bouwen gewoon linkwaarde op en geven dit door. Zie ook mijn artikel hierover “Geeft Een Niet Geïndexeerde Pagina PageRank Door?“)

Linkwaarde nog steeds verdeeld

Het duplicate content probleem is dus opgelost.

Maar het linkwaarde probleem niet: je verdeelt nog steeds de linkwaarde over meerdere pagina’s.

Crawl budget verbruikt

Ook het crawl budget wordt niet efficiënt gebruikt.

Alle gepagineerde pagina’s en de links daarop zullen zoekmachines dus blijven proberen te crawlen.

En het is zonde dat het crawl budget wordt verbruikt door diepgelegen, minder belangrijke pagina’s.

Diepe content onbereikbaar

Door het gebruik van de meta tag robots met de waarde noindex,follow zijn er voor zoekmachines dus nog steeds heel veel te crawlen pagina’s.

Wanneer er veel pagina’s aan gepagineerde content zijn, kan een zoekmachine besluiten te stoppen met crawlen.

Daardoor kan het dus voorkomen dat verder gelegen vervolgpagina’s en de links op die pagina’s niet meer gecrawld worden.

Pagina’s die alleen gelinkt staan op verder gelegen vervolgpagina’s zijn dan niet meer vindbaar in zoekmachines.

SEO problemen opgelost?

Zijn de SEO problemen opgelost met de meta tag robots?

- Duplicate content: opgelost

- Linkwaarde verspilling: niet opgelost

- Crawl budget verspilling: niet opgelost

- Diepe content onbereikbaar: niet opgelost

Waarom geen robots.txt?

Ik heb weleens gezien dat robots.txt werd gebruikt om gepagineerde content te optimaliseren. Dit is echter geen ideale SEO oplossing voor paginering.Door het uitsluiten van gepagineerde content middels robots.txt blokkeer je het crawlen door zoekmachines. Dat lost duplicate content op, omdat Google die gepagineerde pagina’s nooit ziet. Ook het crawl budget wordt niet onnodig gebruikt.

De pagina’s die je in robots.txt uitsluit bouwen nog steeds linkwaarde op, maar deze autoriteit kan niet doorgegeven worden aan andere links. Dat is dus zonde. En diepe content is natuurlijk helemaal niet bereikbaar met robots.txt.

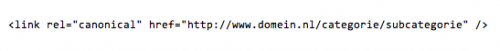

2: canonical tag

Een andere oplossing is de in 2009 door Google gelanceerde canonical tag (uitleg & werking).

De canonical tag plaats je per pagina in de head-sectie van de HTML:

Dit link element geeft aan waar de originele variant van een pagina/URL te vinden is.

De canonical tag is bedoeld voor het oplossen van het duplicate content probleem.

Werking canonical tag

Het resultaat van de canonical tag is:

- Dubbele of identieke pagina’s worden uit de index verwijderd

- Alle link waarde wordt verzameld op de URL waarnaar je de canonical tag verwijst

- Pagina’s waarop de canonical tag staat worden nauwelijks meer gecrawld

Duplicate content is hiermee natuurlijk opgelost.

Ook linkwaarde wordt verzameld en het crawl budget wordt efficiënt benut.

Er blijft echter een belangrijk probleem over: links op gepagineerde pagina’s worden nauwelijks meer gecrawld.

En bij gebruik van de canonical tag wordt alleen de content geïndexeerd van de pagina waarnaar verwezen wordt.

Dus wanneer, bijvoorbeeld bij een webwinkel, sommige producten alleen te vinden zijn via gepagineerde pagina’s, dan zijn deze door de canonical tag zo goed als niet meer bereikbaar voor zoekmachines.

Diepe content is dus niet bereikbaar met de canonical tag.

Dat is natuurlijk niet de bedoeling.

Wanneer niet gebruiken?

Zoals ik schrijf, heeft de canonical tag een duidelijk doel: duplicate content oplossen.

Daarmee is de canonical tag NIET altijd geschikt voor het oplossen van gepagineerde content.

Als de gepagineerde content namelijk niet identiek is, heeft de canonical minder of – in het ergste geval -geen effect.

Ik zie in de praktijk dat duplicate content dan wel verholpen is, maar dat niet alle linkwaarde optimaal wordt benut.

Daarvoor is een oplossing: rel=”prev” en rel=”next” (uitleg volgt direct hieronder).

SEO problemen opgelost?

Zijn de SEO problemen opgelost met de canonical tag?

- Duplicate content: opgelost

- Linkwaarde verspilling: opgelost

- Crawl budget verspilling: opgelost

- Diepe content onbereikbaar: niet opgelost

3: rel=”prev” & rel=”next”

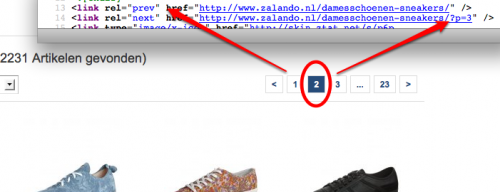

Sinds september 2011 is er de mogelijkheid om de SEO problemen van paginatie op te lossen met de meta tags rel=”prev” en rel=”next”.

Deze elementen zijn al jaren onderdeel van de HTML standaard, maar Google gebruikt ze nu ook voor het oplossen van paginatie problemen (zie aankondiging Google)

De meta tags rel=”prev” en rel=”next” plaats je in de HTML head van de gepagineerde pagina’s:

Met rel=”prev” en rel=”next” geef je aan dat er een relatie is tussen meerdere (gepagineerde) pagina’s.

Werking rel=”prev” en rel=”next”

Wanneer je hiervoor kiest, doet Google het volgende:

- Linkwaarde van individuele gepagineerde samenvoegen aan toewijzen aan de hele serie/set van gepagineerde content

- De meest relevante pagina uit de serie indexeren, meestal de eerste pagina

Het duplicate content probleem is hiermee dus opgelost.

En het belangrijke probleem van linkwaarde verspilling is ook opgelost!

Ook het crawl budget wordt nu efficiënt benut, omdat Google snapt dat de gepagineerde content bij elkaar hoort.

Google blijft de vervolgpagina’s echter nog steeds regelmatig crawlen, dus ook diepe content is en blijft bereikbaar.

Kanttekeningen

Belangrijk bij het gebruik van rel=”prev” en rel=”next” is dat URL parameters hetzelfde blijven voor alle pagina’s in de gepagineerde serie.

Weet ook dat Google het gebruik van rel=”prev” en rel=”next” ziet als sterke hint, maar niet altijd als opdracht opvolgt.

Het gebruik van rel=”prev” en rel=”next” is leidend ten opzichte van de “Toon alles”-pagina. Uitleg hierover volgt direct hieronder.

SEO problemen opgelost?

Zijn de SEO problemen opgelost met rel=”prev” en rel=”next”?

- Duplicate content: opgelost

- Linkwaarde verspilling: opgelost

- Crawl budget verspilling: opgelost

- Diepe content onbereikbaar: opgelost

4: “Toon alles”-pagina

Een eenvoudige, maar effectieve oplossing is een “Toon alles”-pagina.

Dit is een pagina die alle gepagineerde content op één pagina toont.

Google “begrijpt” dit steeds beter

Als Google kan herkennen dat een gepagineerde serie ook een “Toon alles”-pagina bevat, dan doet Google het volgende:

- De linkwaarde van alle gepagineerde pagina’s in de serie wordt samengevoegd op de “Toon alles”-pagina.

- De “Toon alles”-pagina wordt (meestal) geïndexeerd en in de zoekresultaten teruggegeven.

Maar, let op: dit is geen garantie!

Je laat de controle hiermee bij Google, terwijl je dit ook zelf in de hand kunt houden.

Canonical tag naar “Toon alles”-pagina

Om er zeker van te zijn dat Google altijd de “Toon alles”-pagina indexeert en altijd de linkwaarde samenvoegt op de “Toon alles”-pagina, is de canonical tag noodzakelijk.

Verwijs dan altijd met de canonical tag vanaf elke gepagineerde pagina in de serie naar de “Toon alles”-pagina.

Duplicate content is hiermee geen probleem meer, omdat Google altijd de “Toon alles”-pagina pakt.

Zoals gezegd, wordt ook alle linkwaarde benut en geconcentreerd op de “Toon alles”-pagina.

Ook het crawl budget wordt efficiënt ingezet en alle diepe content is natuurlijk bereikbaar op de “Toon alles”-pagina.

Let op de laadtijd

Belangrijk is wel dat de laadtijd van de “Toon alles”-pagina niet te hoog is.

Google geeft aan dat een laadtijd van ongeveer 3 tot 4 seconden prima is.

Niet doen bij grote sites

Bij grote sites zou ik echter niet gaan voor een “Toon alles”-pagina.

Waneer je honderden of zelfs duizenden links (producten, artikelen, etc.) op een “Toon alles”-pagina krijgt, dan zijn zowel de bezoekers als zoekmachines niet blij.

Bezoekers gaan niet oneindig scrollen (al is de usability nog wel op te lossen met een techniek als AJAX).

En zoekmachines stoppen op een gegeven moment toch echt met crawlen.

Voor grote sites zou ik zeker kiezen voor rel=”prev” en rel=”next”.

SEO problemen opgelost?

Zijn de SEO problemen opgelost met de “Toon alles”-pagina?

- Duplicate content: opgelost

- Linkwaarde verspilling: opgelost

- Crawl budget verspilling: opgelost

- Diepe content onbereikbaar: opgelost

Conclusie

Gepagineerde content, ook wel paginatie, is het verspreiden van content over meerdere pagina’s (= URL’s). Dit levert 4 SEO problemen op:

- Duplicate content

- Linkwaarde verspilling

- Crawl “budget” verspilling

- “Diepe” content onbereikbaar

Beste SEO oplossing?

In dit artikel benoem ik 4 oplossingen voor de SEO problemen van paginering.

In dit schema is te zien dat er 2 oplossingen alle problemen oplossen:

Wel of geen “Toon alles”-pagina

De beste SEO oplossing voor gepagineerde content hangt af van de aanwezigheid van een “Toon alles”-pagina.

Is er een “Toon alles”-pagina aanwezig (en is de laadtijd 3 tot 4 seconden)?

- Ja:

Verwijs gepagineerde pagina’s met canonical tag naar “Toon alles”-pagina - Nee:

Gebruik rel=”prev” en rel=”next”

In beide gevallen is gepagineerde content geen SEO probleem meer, maar levert het je een verbeterde vindbaarheid op!

Bronnen & meer informatie

- Video met uitleg van Google zelf Tip! (16 minuten)

- Google Helpcentrum over Paginering

- 3 Methods For Managing Pagination According to SEO Best Practices (SearchEngineLand.com)

- Implementing Pagination Attributes Correctly For Google (SearchEngineLand.com)

- Conquering Pagination – A Guide to Consolidating your Content (ayima.com)